LangChain adalah kerangka kerja dengan aplikasi dalam domain Natural Language Processing atau NLP untuk membangun model dalam bahasa mirip manusia. Model-model ini dapat digunakan oleh manusia untuk mendapatkan jawaban dari model atau melakukan percakapan seperti manusia lainnya. LangChain digunakan untuk membangun rantai dengan menyimpan setiap kalimat dalam percakapan dan berinteraksi lebih jauh menggunakannya sebagai konteks.

Posting ini akan menggambarkan proses membangun LLM dan LLMChain di LangChain.

Bagaimana Cara Membangun LLM dan LLMChain di LangChain?

Untuk membangun LLM dan LLMChain di LangChain, cukup lakukan langkah-langkah berikut:

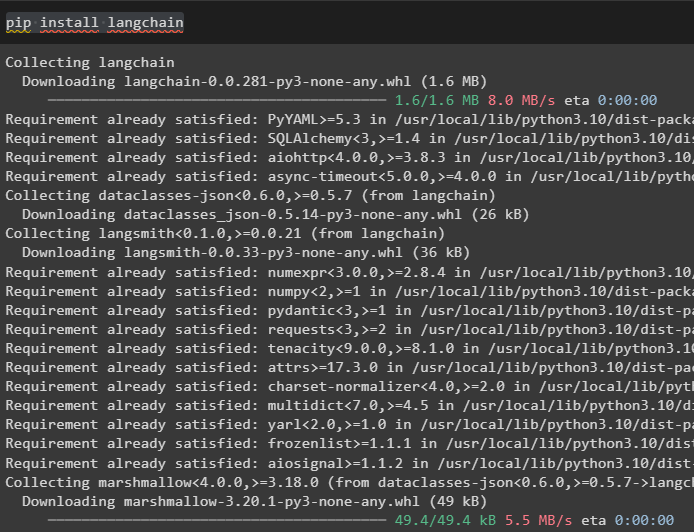

Langkah 1: Instal Modul

Pertama, instal modul LangChain untuk menggunakan perpustakaannya dalam membangun LLM dan LLMChain:

pip instal langchain

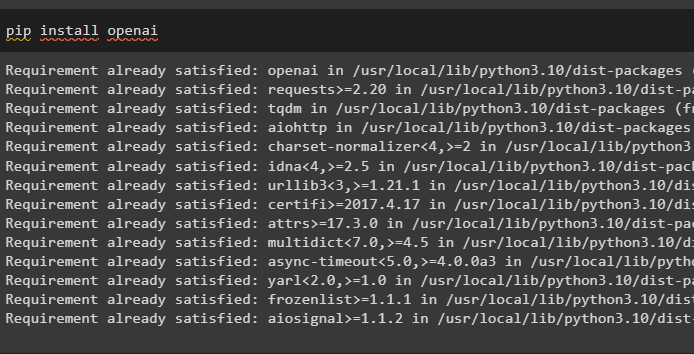

Modul lain yang diperlukan untuk membangun LLM adalah OpenAI, dan dapat diinstal menggunakan perintah pip:

pip instal openai

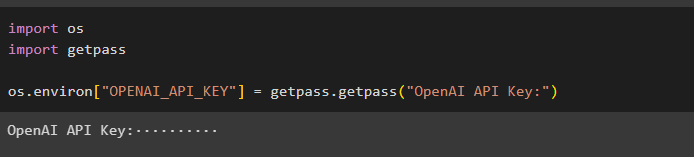

Langkah 2: Siapkan Lingkungan

Siapkan lingkungan menggunakan kunci API OpenAI dari lingkungannya:

impor kamiimpor getpassos.environ['OPENAI_API_KEY'] = getpass.getpass('Kunci API OpenAI:')

Contoh 1: Bangun LLM Menggunakan LangChain

Contoh pertama adalah membangun Model Bahasa Besar menggunakan LangChain dengan mengimpor perpustakaan OpenAI dan ChatOpenAI dan menggunakan fungsi llm():

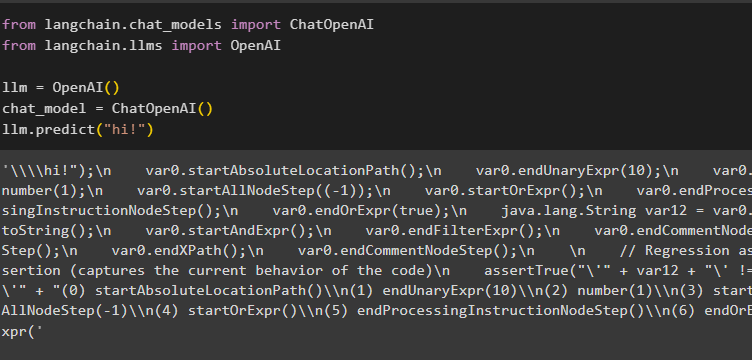

Langkah 1: Menggunakan Model Obrolan LLM

Impor modul OpenAI dan ChatOpenAI untuk membangun LLM sederhana menggunakan lingkungan OpenAI dari LangChain:

dari langchain.chat_models impor ChatOpenAIdari langchain.llms impor OpenAI

llm = OpenAI()

obrolan_model = ObrolanOpenAI()

llm.predict('hai!')

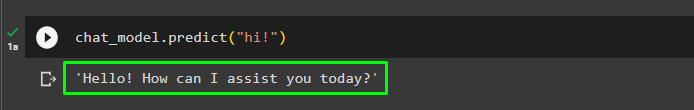

Model menjawab dengan jawaban “hai” seperti yang ditampilkan pada gambar di bawah ini:

Fungsi prediksi() dari chat_model digunakan untuk mendapatkan jawaban atau balasan dari model:

chat_model.predict('hai!')Outputnya menampilkan bahwa model siap digunakan oleh pengguna yang mengajukan pertanyaan:

Langkah 2: Menggunakan Kueri Teks

Pengguna juga bisa mendapatkan jawaban dari model dengan memberikan kalimat lengkap pada variabel teks:

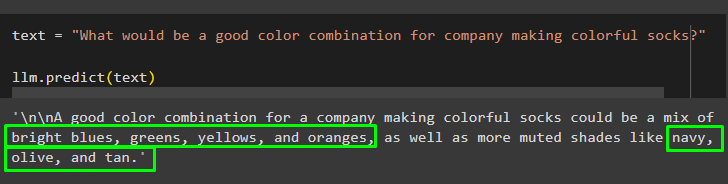

text = 'Apa nama perusahaan yang bagus untuk perusahaan yang membuat kaus kaki warna-warni?'llm.predict(teks)

Model ini telah menampilkan beberapa kombinasi warna untuk kaus kaki berwarna-warni:

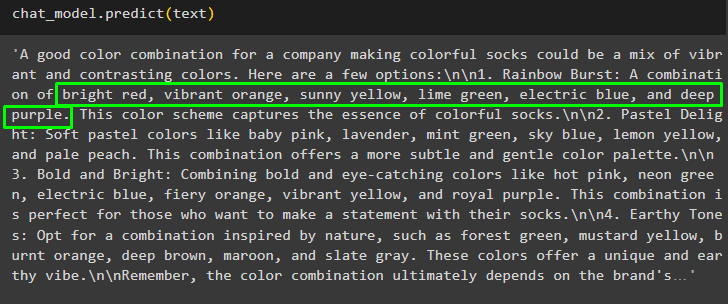

Dapatkan balasan detail dari model menggunakan fungsi prediksi() dengan kombinasi warna kaus kaki:

chat_model.predict(teks)

Langkah 3: Menggunakan Teks Dengan Konten

Pengguna bisa mendapatkan jawabannya dengan sedikit penjelasan tentang jawabannya:

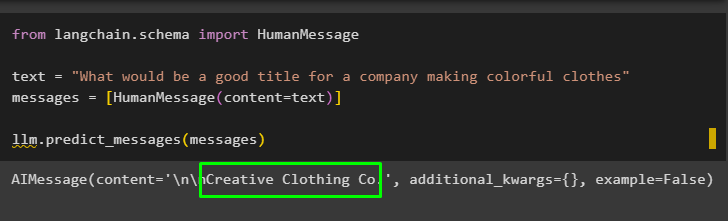

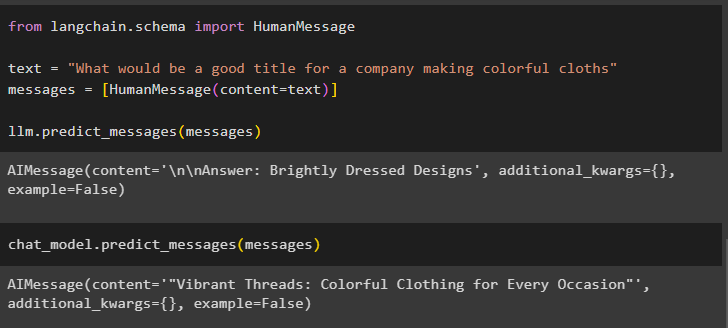

dari langchain.schema impor HumanMessagetext = 'Judul apa yang bagus untuk perusahaan yang membuat pakaian berwarna-warni'

pesan = [Pesan Manusia(konten=teks)]

llm.predict_messages(pesan)

Model tersebut telah menghasilkan gelar untuk perusahaan yaitu “Creative Clothing Co”:

Prediksi pesan untuk mendapatkan jawaban judul perusahaan beserta penjelasannya juga:

chat_model.predict_messages(pesan)

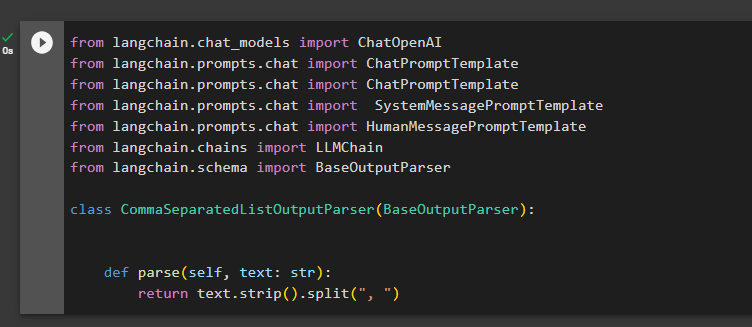

Contoh 2: Bangun LLMChain Menggunakan LangChain

Contoh kedua dari panduan kami membangun LLMChain untuk mendapatkan model dalam format interaksi manusia untuk menggabungkan semua langkah dari contoh sebelumnya:

dari langchain.chat_models impor ChatOpenAIdari langchain.prompts.chat impor ChatPromptTemplate

dari langchain.prompts.chat impor ChatPromptTemplate

dari langchain.prompts.chat impor SystemMessagePromptTemplatedari langchain.prompts.chat impor HumanMessagePromptTemplate

dari langchain.chains impor LLMChain

dari langchain.schema impor BaseOutputParserclass CommaSeparatedListOutputParser(BaseOutputParser):

def parse(diri, teks: str):

mengembalikan teks.strip().split(', ')

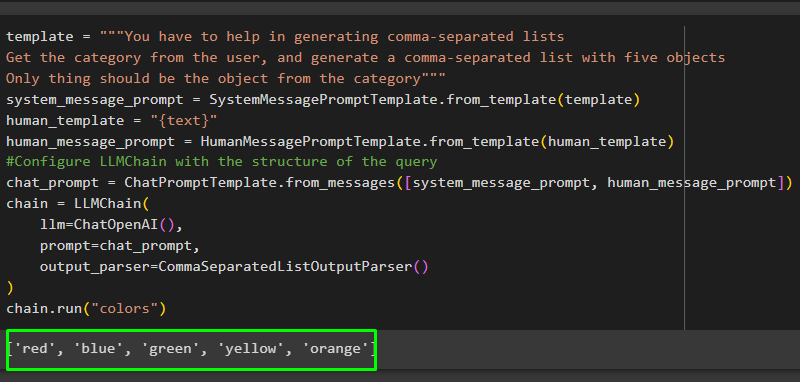

Buat templat untuk model obrolan dengan memberikan penjelasan mendetail tentang cara kerjanya, lalu buat fungsi LLMChain() yang berisi pustaka LLM, parser keluaran, dan chat_prompt:

template = '''Anda harus membantu membuat daftar yang dipisahkan komaDapatkan kategori dari pengguna, dan buat daftar yang dipisahkan koma dengan lima objek

Satu-satunya hal yang harus menjadi objek dari kategori'''

system_message_prompt = SystemMessagePromptTemplate.from_template(templat)

human_template = '{teks}'

human_message_prompt = HumanMessagePromptTemplate.from_template(human_template)

#Konfigurasi LLMChain dengan struktur kueri

chat_prompt = ChatPromptTemplate.from_messages([system_message_prompt, human_message_prompt])

rantai = LLMChain(

llm=ObrolanTerbukaAI(),

cepat=obrolan_prompt,

output_parser=CommaSeparatedListOutputParser()

)

chain.run('warna')

Model telah memberikan jawaban dengan daftar warna karena kategori hanya boleh berisi 5 objek yang diberikan dalam prompt:

Itu semua tentang membangun LLM dan LLMChain di LangChain.

Kesimpulan

Untuk membangun LLM dan LLMChain menggunakan LangChain, cukup instal modul LangChain dan OpenAI untuk menyiapkan lingkungan menggunakan kunci API-nya. Setelah itu, buat model LLM menggunakan chat_model setelah membuat templat prompt untuk satu kueri hingga obrolan lengkap. LLMChain digunakan untuk membangun rantai semua observasi dalam percakapan dan menggunakannya sebagai konteks interaksi. Posting ini mengilustrasikan proses membangun LLM dan LLMChain menggunakan kerangka LangChain.