LangChain adalah kerangka kerja yang berisi banyak dependensi dan pustaka yang dapat digunakan untuk membangun Model Bahasa Besar. Model-model ini dapat digunakan untuk berinteraksi dengan manusia tetapi pertama-tama, model harus belajar bagaimana mendapatkan/memahami prompt/pertanyaan yang diajukan oleh manusia. Untuk itu, model perlu dilatih pada template prompt dan kemudian pengguna mengajukan pertanyaan dalam template yang diberikan.

Panduan ini akan mengilustrasikan proses pembuatan templat cepat di LangChain.

Bagaimana Cara Membuat Template Cepat di LangChain?

Untuk membuat templat cepat di LangChain, cukup ikuti panduan berikut dengan beberapa langkah:

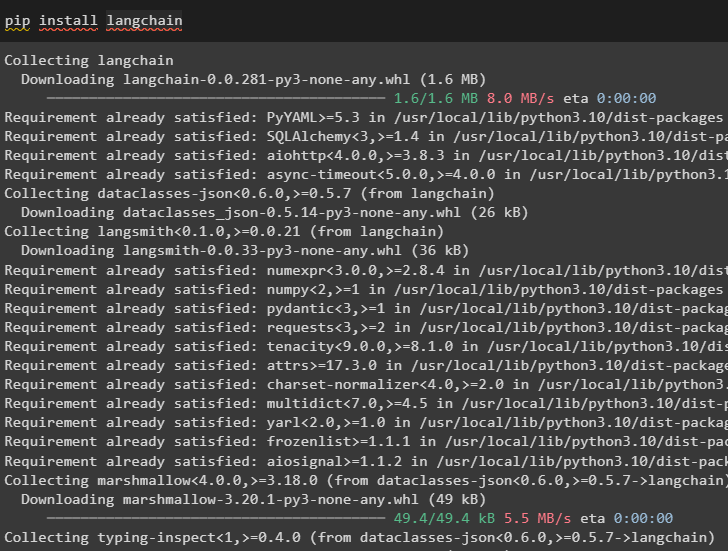

Langkah 1: Instal Modul dan Lingkungan Pengaturan

Mulai proses pembuatan templat cepat di LangChain dengan menginstal kerangka LangChain:

pip instal langchain

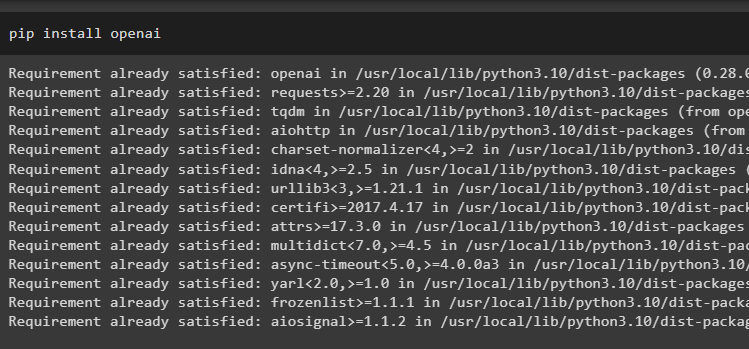

Sekarang, instal modul OpenAI untuk mengakses perpustakaannya dan atur lingkungan yang menggunakannya:

pip instal openai

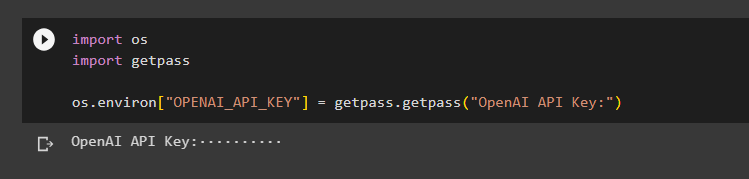

Siapkan lingkungan OpenAI menggunakan perpustakaan os untuk mengakses sistem operasi dan menyediakan kunci API OpenAI:

impor kamiimpor getpass

os.environ['OPENAI_API_KEY'] = getpass.getpass('Kunci API OpenAI:')

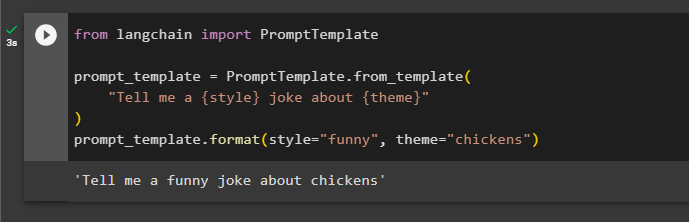

Langkah 2: Menggunakan Templat Prompt

Setelah menginstal LangChain, cukup impor perpustakaan PromptTemplate dan buat templat untuk kueri tentang lelucon dengan beberapa aspek tambahan sebagai variabel seperti kata sifat, konten, dll.:

dari langchain impor PromptTemplateprompt_template = PromptTemplate.from_template(

'Ceritakan padaku lelucon {style} tentang {tema}'

)

prompt_template.format(style='lucu', tema='ayam')

Prompt telah disetel dan diberikan kepada model dengan nilai variabel yang dimasukkan ke dalam perintah:

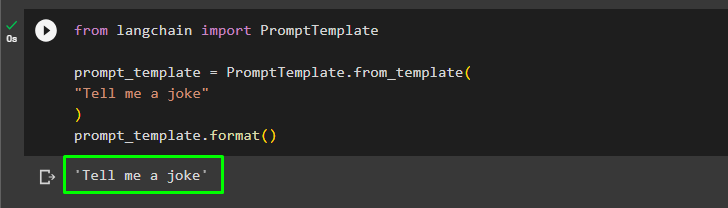

Pengguna dapat menyesuaikan templat prompt dengan kueri sederhana yang menanyakan lelucon:

dari langchain impor PromptTemplateprompt_template = PromptTemplate.from_template(

'Ceritakan padaku sebuah lelucon'

)

prompt_template.format()

Cara di atas adalah untuk satu pertanyaan dan jawaban tetapi terkadang pengguna ingin berinteraksi dengan model dalam bentuk obrolan dan bagian selanjutnya menjelaskan formatnya.

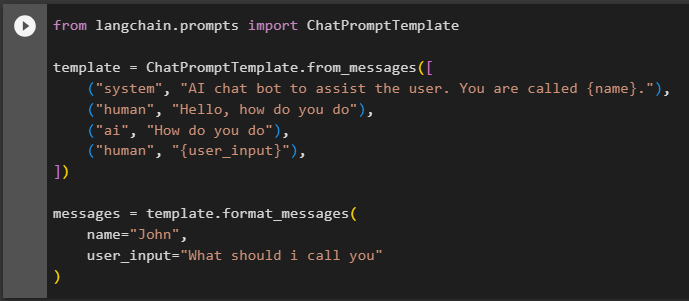

Langkah 3: Menggunakan Template Prompt Obrolan

Bagian ini menjelaskan template model obrolan yang didasarkan pada pola percakapan seperti dua manusia yang berinteraksi satu sama lain:

dari langchain.prompts impor ChatPromptTemplatetemplat = ChatPromptTemplate.from_messages([

('sistem', 'bot obrolan AI untuk membantu pengguna. Anda dipanggil {nama}.'),

(“manusia”, “Halo, apa kabar”),

(“ai”, “Bagaimana kabarmu”),

('manusia', '{user_input}'),

])

pesan = templat.format_pesan(

nama='John',

user_input='Saya harus memanggil Anda apa'

)

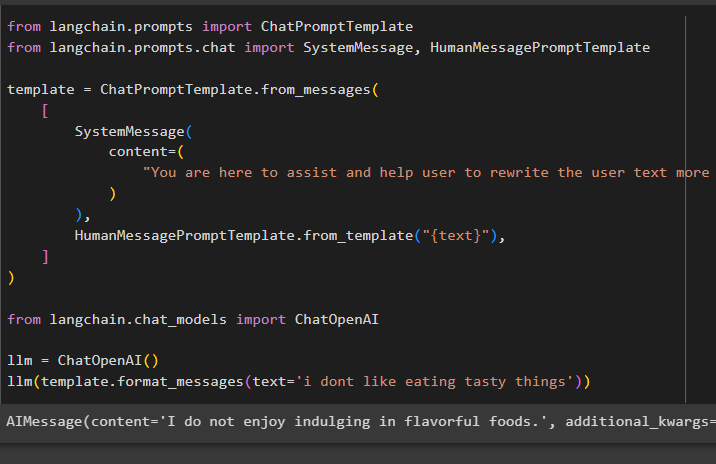

Setelah mengatur struktur template, cukup tulis beberapa baris dalam teks untuk memberi tahu model apa yang diharapkan darinya dan gunakan fungsi llm() untuk memberikan prompt:

dari langchain.prompts impor ChatPromptTemplatedari langchain.prompts.chat impor SystemMessage, HumanMessagePromptTemplate

templat = ChatPromptTemplate.from_messages(

[

Pesan sistem(

isi=(

'Anda di sini untuk membantu dan membantu pengguna menulis ulang teks pengguna dengan lebih efektif'

)

),

HumanMessagePromptTemplate.from_template('{teks}'),

]

)

dari langchain.chat_models impor ChatOpenAI

llm = ObrolanOpenAI()

llm(template.format_messages(text='saya tidak suka makan yang enak'))

Metode SystemMessage() berisi konten balasan untuk kueri yang digunakan dalam LLM:

Sekian tentang membuat templat cepat di LangChain.

Kesimpulan

Untuk membuat template prompt di LangChain, cukup instal modul LangChain dan OpenAI untuk menyiapkan lingkungan menggunakan kunci API OpenAI. Setelah itu, buat template prompt untuk satu prompt seperti menanyakan lelucon atau satu pertanyaan tentang apa pun. Cara lainnya adalah dengan mengkustomisasi template model chat berdasarkan proses interaksi antara dua manusia yang berbeda. Posting ini telah mengilustrasikan proses pembuatan template prompt di LangChain.